8 ans, 100 dollars : un LLM local dépasse la RTX 3060

Une carte serveur Nvidia de 2017, payée 100 dollars sur eBay, sort plus de tokens par seconde qu’une RTX 3060 sur des modèles d’IA en local, atteignant environ 130 tokens par seconde sur le modèle gpt-oss-20b. À sa sortie en 2017, cette carte se négociait au-delà de 10 000 dollars et embarque 5120 cœurs CUDA et 640 cœurs Tensor, sans la moindre sortie vidéo.

Une carte serveur Nvidia de 2017, achetée pour 100 dollars sur eBay, génère plus de tokens par seconde qu’une RTX 3060 lors de l’utilisation de modèles d’intelligence artificielle en local. L’expérience d’un YouTubeur met en lumière que le matériel d’entreprise d’occasion représente un segment souvent négligé du marché.

La scène provient de la chaîne YouTube Hardware Haven, relayée par Tom’s Hardware et VideoCardz. Le principe consiste à utiliser une Nvidia Tesla V100 SXM2 16 Go, âgée de huit ans et conçue pour les racks de centres de données, en l’installant dans un PC classique.

Pour un coût total d’environ 200 dollars (comprenant la carte, un adaptateur SXM2 vers PCIe, un ventilateur Noctua de 80 mm et un carénage imprimé en 3D), le montage fonctionne.

Lors de son lancement en 2017, cette carte se vendait au-delà de 10 000 dollars. Elle est dotée de 5120 cœurs CUDA et 640 cœurs Tensor, la première génération de ces unités dédiées au calcul d’IA de Nvidia, et ne possède aucune sortie vidéo : il s’agit d’un accélérateur de calcul, et non d’une carte graphique.

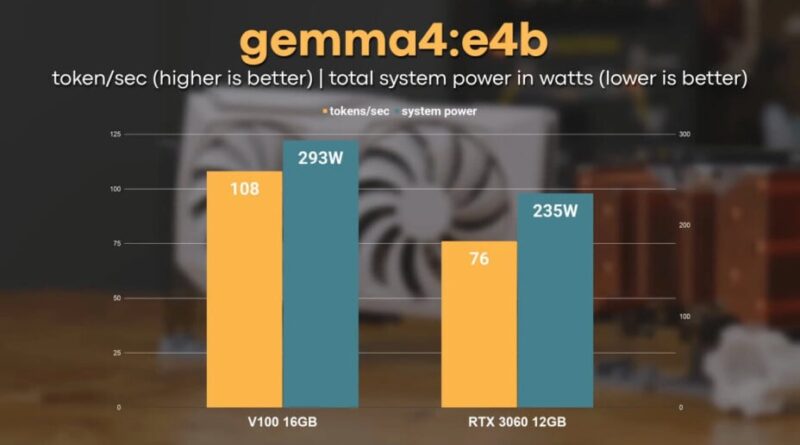

Les performances sont impressionnantes par rapport aux modèles récents. Sur le modèle gpt-oss-20b via Ollama, le LLM exprimé en local, la V100 atteint environ 130 tokens par seconde, contre 90 pour une RX 7800 XT 16 Go. Le LLM Gemma 4 de Google s’adapte également très bien à cette carte.

De manière plus explicite : toutes deux limitées à 100 W pour le GPU, la V100 produit 95 tokens/s alors que la RTX 3060 12 Go s’arrête à 68, selon Tom’s Hardware.

Cela représente 0,55 contre 0,39 token par watt, en faveur de la carte plus ancienne. En mode veille, elle consomme néanmoins 45 W contre 35 pour la 3060, un facteur à considérer pour une machine fonctionnant en continu.

À ce tarif, la V100 constitue un excellent choix pour ceux souhaitant exécuter un LLM chez eux, à condition d’accepter que Nvidia a déjà interrompu le support CUDA pour Volta avec la version 12.8 du toolkit et que la prochaine mise à jour majeure ne le prendra plus en charge. En résumé, il faut être conscient des limitations, mais l’expérience reste pertinente.