La sortie surprise de DeepSeek V4 le jour de GPT-5.5.

DeepSeek a lancé V4, un modèle open source de 1,6 billion de paramètres, qui coûte 7 à 9 fois moins cher que ses rivaux américains. V4 Pro se paie 1,74 dollar le million de tokens en entrée et 3,48 dollars en sortie, tandis que le modèle Flash coûte 0,14 dollar en entrée et 0,28 dollar en sortie.

**DeepSeek a profité du lancement de GPT-5.5 par OpenAI pour sortir V4, un modèle open source de 1,6 billion de paramètres qui coûte 7 à 9 fois moins cher que ses concurrents américains. Un timing qui ne semble pas être dû au hasard.**

Le jeudi 23 avril, OpenAI présente GPT-5.5, son modèle le plus coûteux jamais commercialisé. Quelques heures plus tard, DeepSeek met en ligne ses modèles sur Hugging Face sous licence MIT, sans conférence, sans annonce préalable, et sans PDG. Juste un lien, un prix et 1,6 billion de paramètres disponibles au téléchargement. En somme, une stratégie qui semble viser à gâcher la fête sans même se faire inviter.

DeepSeek V4 est disponible en deux versions, Pro et Flash, toutes deux utilisant un système de « mixture-of-experts » avec 1 million de tokens de contexte. Le principe est simple : un modèle gigantesque découpé en « experts » spécialisés, dont seule une petite partie est activée pour chaque requête. Cela permet de conserver la puissance d’un modèle massif sans avoir à supporter le coût de calcul à chaque fois.

La version Pro présente 1,6 billion de paramètres au total, dont 49 milliards sont activés par requête. Cela en fait, en théorie, le plus grand modèle open source sur le marché, devant Kimi K2.6 de Moonshot (1,1 billion) et plus du double de la version précédente V3.2 (671 milliards). La version Flash, plus réduite, utilise 284 milliards de paramètres, dont 13 milliards sont activés. Les deux peuvent être téléchargées librement sous licence MIT, et l’API est déjà accessible.

**Un prix qui ridiculise la concurrence, mais avec des réserves.**

La véritable surprise réside dans le coût. V4 Pro est facturé 1,74 dollar par million de tokens en entrée et 3,48 dollars en sortie. En comparaison, Claude Opus 4.7 coûte 5 dollars pour l’entrée et 25 dollars pour la sortie, tandis que les tarifs de GPT-5.5 sont encore plus élevés. Cela représente un rapport de 7 à 9 en défaveur des entreprises américaines.

Pour la version Flash, les tarifs sont encore plus bas, soit 0,14 dollar pour l’entrée et 0,28 dollar pour la sortie par million de tokens, ce qui est inférieur aux prix de GPT-5.4 Nano ou Claude Haiku 4.5. Par exemple, traiter 100 millions de tokens de sortie coûte environ 348 dollars chez DeepSeek, contre 2 500 dollars chez Anthropic. Cette différence pourrait couvrir les salaires d’une petite entreprise sur une année.

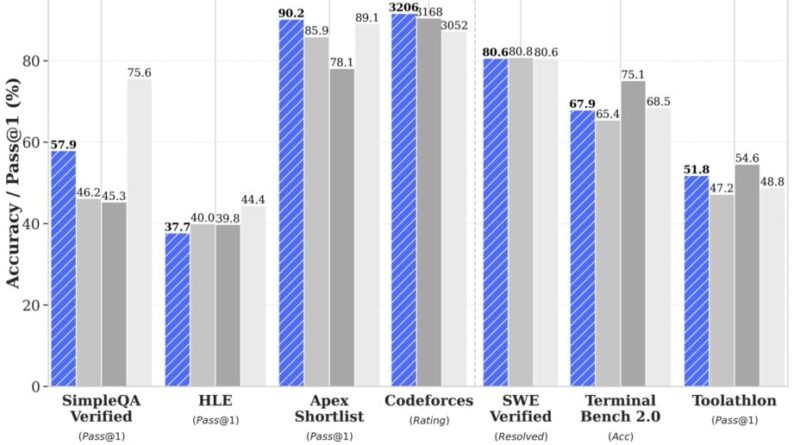

En matière de performances, V4 Pro surpasse tous les modèles open source en mathématiques, en programmation et en raisonnement, et dépasse également GPT-5.4 sur Codeforces avec un score de 3206. Cependant, pour les tâches de connaissance factuelle et les benchmarks de savoir (HLE, SimpleQA), Gemini 3.1 Pro et GPT-5.4 restent en tête. DeepSeek reconnaît d’ailleurs que son modèle est « à la traîne de 3 à 6 mois » derrière ses concurrents américains. Un détail important à noter : V4 ne traite que du texte, n’intégrant ni images, ni audio, ni vidéo, contrairement à la plupart des modèles fermés qui offrent des capacités multimodales depuis un certain temps.

**Pour qui, pour quoi, et les points à considérer.**

Dans les faits, V4 s’adresse aux développeurs et aux entreprises traitant de grands volumes de données, aux équipes souhaitant auto-héberger un modèle sans transmettre leurs requêtes à Sam Altman, ainsi qu’aux pays cherchant à éviter une dépendance totale à la Silicon Valley.

L’argument de la licence MIT est significatif pour les secteurs de la finance, de la santé ou des affaires juridiques.

Pour l’utilisateur final qui interagit avec un chatbot sur son téléphone, l’intérêt de V4 Pro semble plus théorique. En effet, ce modèle pèse 865 Go à télécharger, ce qui dissuade nombre d’utilisateurs de l’exécuter chez eux. De plus, l’API officielle fonctionne via des serveurs chinois, soulevant des préoccupations habituelles concernant la souveraineté des données.

Il est également important de prendre en compte le contexte politique. Le lancement coïncide avec des accusations américaines reprochant à la Chine un « vol de propriété intellectuelle à l’échelle industrielle » à travers des milliers de comptes proxy.

Anthropic et OpenAI accusent depuis longtemps DeepSeek de pratiquer ce qu’ils qualifient de « distillation », c’est-à-dire d’entraîner ses modèles en utilisant les sorties des leurs. Bien qu’il soit difficile de prouver ces allégations, l’atmosphère est tendue, et V4 ne devrait pas alléger les relations.