La fréquence des processeurs ne dépasse plus 5 GHz depuis 20 ans.

Dans les années 90, la fréquence d’horloge était le seul critère de performance pour les processeurs, avec par exemple un processeur à 500 MHz considéré comme deux fois plus rapide qu’un modèle à 250 MHz. Selon BitLemon, si on avait continué à augmenter la fréquence vers les 10 GHz, « cela générerait suffisamment de chaleur pour faire littéralement fondre le silicium ».

Pour ceux ayant grandi dans les années 90, la fréquence d’horloge était le seul critère déterminant. Un processeur fonctionnant à 500 MHz était, en théorie, deux fois plus rapide qu’un modèle à 250 MHz. Ce critère était simple, prévisible et particulièrement efficace pour le marketing.

Cette avancée technologique a reposé pendant des décennies sur deux principes clés. D’abord, la célèbre Loi de Moore, qui anticipait un doublement du nombre de transistors tous les deux ans. Toutefois, l’augmentation du nombre de composants sur une même surface entraînait des problèmes thermiques. C’est ici qu’intervient un second principe, moins connu mais essentiel : l’échelle de Dennard.

En 1974, Robert Dennard (IBM) découvre une étonnante propriété physique. En réduisant la taille d’un transistor, il est possible de diminuer sa tension d’alimentation tout en maintenant la stabilité du composant. Cela représentait un « ticket gratuit » pour l’industrie : augmentation de la densité, réduction de la tension et consommation totale stable.

Le jour où le ticket gratuit a pris fin

Le problème ? Une limite physique a été atteinte. Pour fonctionner, un transistor nécessite une tension minimale (la tension de seuil). Vers 2005, elle a été réduite à 1 volt, rendant impossible toute nouvelle diminution sans déstabiliser la puce.

De plus, avec l’amincissement des composants, les électrons ont commencé à s’échapper. On parle ici de l’effet tunnel quantique : même hors tension, le processeur perd de l’électricité. Cette énergie perdue se transforme en chaleur. C’est ce que l’on désigne comme le mur de puissance.

La chaîne BitLemon explique cela très clairement. Si la fréquence avait continué à progresser vers les 10 GHz, « cela aurait généré suffisamment de chaleur pour faire littéralement fondre le silicium », selon BitLemon. Les systèmes de refroidissement traditionnels n’auraient jamais pu supporter une telle chaleur, ce qui a conduit les fabricants à mettre un frein.

Au lieu de se concentrer sur l’exécution rapide d’une seule tâche, l’accent a été mis sur l’augmentation du nombre de cœurs pour gérer plusieurs tâches en simultané. « L’accent est passé de la latence au débit », précise la vidéo. En d’autres termes, l’objectif n’est plus de mesurer la vitesse d’achèvement d’une tâche, mais plutôt combien de tâches peuvent être traitées en même temps.

Pour aller plus loin

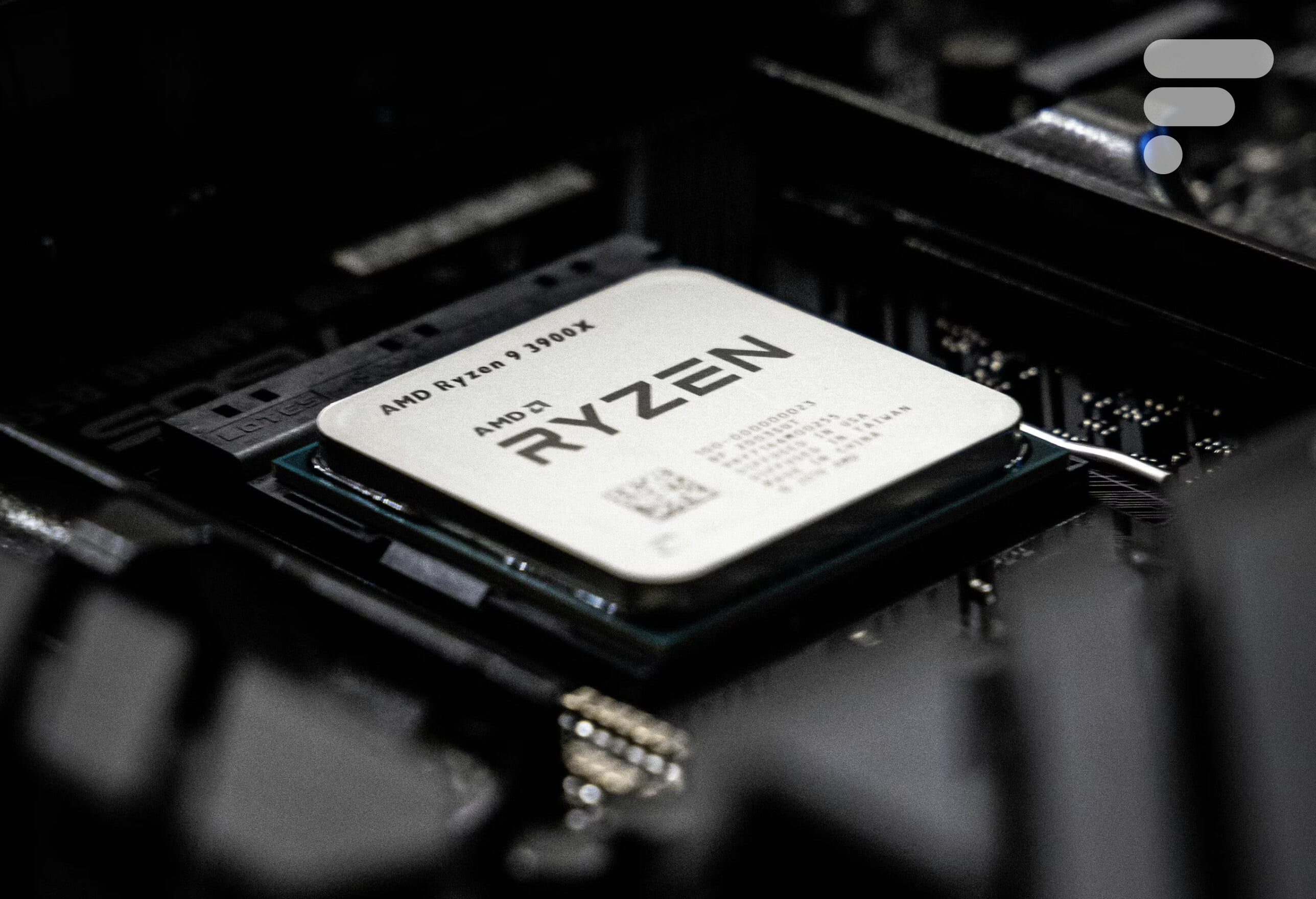

Quels sont les meilleurs processeurs (CPU) Intel et AMD Ryzen en 2026 ?