« A l’avenir chacun aura des IA, une sorte d’équipe d’assistants virtuels, avec lui en permanence »

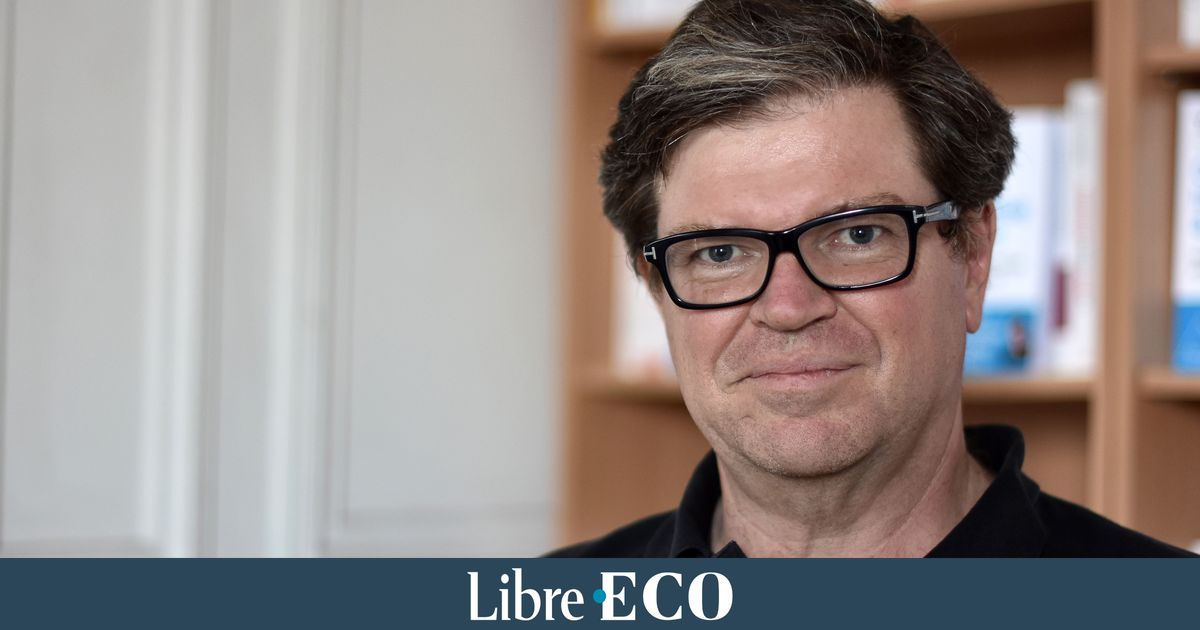

Inconnu du grand public, le Français de 62 ans – il en fait bien dix de moins – n’en est pas moins un ponte dans le milieu de l’intelligence artificielle. Il s’est distingué pour ses travaux sur les neurones convolutifs et le deep learning, a reçu le prix Turing (l’équivalent du Nobel d’informatique) en 2018 et a créé FAIR, le laboratoire d’intelligence artificielle de Facebook (aujourd’hui Meta) en 2013 après que Mark Zuckerberg a fait des pieds et des mains pour le recruter. Dans les médias américains, on le surnomme même le « parrain de l’intelligence artificielle ».

A une époque où les outils numériques pullulent – du système de dialogue ChatGPT développé par l’entreprise américaine OpenAI aux générateurs d’images Midjourney ou Dall-E – les sorties de Yann Le Cun sont particulièrement suivies. Tout le monde veut son avis sur la popularisation de la technologie utilisée par ChatGPT mais aussi par Google, Meta et d’autres depuis quelques années pour la compréhension de la langue ou encore la traduction. Son temps est précieux : de passage à Paris, il a refusé les demandes d’interview individuelle. Seul cadre de rencontre possible : lors d’un repas organisé par Odile Jacob, son éditrice, pour la sortie en poche de son livre Quand la machine apprend. Alors Libé s’est assis à sa table et a pu échanger avec ce techno-enthousiaste qui voit en l’IA une possibilité pour la société de progresser.

Les IA actuelles, des systèmes « très superficiels, incohérents et non factuels »

« Aujourd’hui, des applications permettent de rédiger des textes entiers grâce aux grands modèles de langages. Cela paraît assez extraordinaire, on a l’impression que le système comprend ce qu’on lui raconte, qu’il nous répond. Mais ce n’est pas fiable. Les modèles actuels doivent prédire en permanence, en fonction de probabilités, la suite d’une séquence de mots. Mais comme ce sont des probabilités, il peut y avoir des erreurs. Et plus le texte est long, plus les erreurs peuvent s’accumuler. Ces systèmes sont donc très superficiels et peuvent être incohérents et non factuels », analyse-t-il.

« On peut s’en servir comme d’une aide, comme d’une source d’inspiration, mais pas comme une source d’information. C’est un peu comme les systèmes d’aide à la conduite dans les voitures : il faut toujours garder ses mains sur le volant. Ici c’est la même chose : il faut toujours garder ses mains sur le clavier et vérifier les faits. »

Chez Méta, « on ne peut pas sortir un système de dialogue qui dit des bêtises »

« La raison pour laquelle les grandes entreprises ne sortent pas ces technologies, ce n’est pas parce qu’elles n’ont pas les moyens de le faire mais parce qu’il est difficile de les mettre sur le marché avant qu’elles soient plus fiables. Une petite entreprise comme OpenAI peut se permettre de sortir un système de dialogue qui dit des bêtises. Mais si Google ou Meta fait la même chose, on se ferait trucider », glisse-t-il encore.

« C’est d’ailleurs littéralement ce qui est arrivé : Meta a sorti en novembre Galactica, une IA entraînée sur l’aide à l’écriture pour les chercheurs qui rédigent des articles scientifiques. Mais il a été très critiqué par certaines personnes dans le milieu de la recherche. Elles disaient que ça allait être un désastre parce que n’importe qui pouvait écrire quelque chose qui ressemble à un article scientifique mais qui en fait ne l’était pas. La démo a finalement été rapidement retirée. »

« Meta et Google ont quand même réalisé avec l’intérêt pour ChatGPT qu’il y avait quelque chose à faire en IA. Chez Meta, on a créé un cinquième groupe de produit, Generative AI, autour de systèmes de dialogue, de production d’images par descriptions textuelles et de systèmes de production vidéo et de contenu 3D pour le métavers. C’est une organisation de produit au même titre que Facebook, WhatsApp, Messenger et Instagram. »

L’open source, la clé d’une IA pour tous

« Jusqu’à présent, la recherche en IA était très largement ouverte. Mais certains acteurs comme OpenAI, qui par le passé contribuaient à la recherche, se sont refermés comme des huîtres, ne disant plus rien sur leur technologie. Si tout le monde commence à effectuer ses recherches en secret, c’est le risque que tout évolue plus lentement. L’entraînement d’un modèle de langage coûte très cher, des dizaines de millions de dollars. Il faut évidemment embaucher des gens, et des gens compétents, il n’y en a pas beaucoup. »

« Refuser l’open source, ça limite l’essor de l’industrie et fait que l’IA ne bénéficie qu’à un petit groupe de puissants. Chez Méta, on a lancé en février LLaMa, notre modèle de langage en open source dans ce but. Si les gouvernements veulent favoriser l’essor de l’industrie de l’IA, promouvoir des plateformes open source serait la meilleure chose à faire. »

« Il manque quelque chose pour faire des machines vraiment intelligentes »

« Chez Meta, on se concentre sur la prochaine génération d’IA. Elle sera pilotable, factuelle et aura des capacités de raisonnement et de planification. Ça prendra probablement du temps avant que ces systèmes fonctionnent et soient déployés. Mais c’est la prochaine révolution annoncée de l’IA. Les systèmes tel qu’on les connaît à l’heure actuelle, à mon avis, auront une durée de vie très courte », explique encore Yann Le Cun.

« Paradoxalement, ils peuvent apparemment répondre à des questions très complexes, écrire du code, traduire ou parler énormément de langues, et ont une accumulation de savoir qui est presque surhumaine. Mais en même temps, on n’a toujours pas de voiture autonome. Et on est très loin d’avoir un robot qui puisse débarrasser la table et remplir le lave-vaisselle alors qu’un enfant de 10 ans peut le faire. Il nous manque quelque chose d’essentiel pour faire des machines qui soient vraiment intelligentes, qui comprennent comment fonctionne le monde, qui aient un certain sens commun. On ne sait pas le faire. »

« C’est un peu ce qu’on appelle le paradoxe de Moravec, qui a été énoncé il y a de très nombreuses années : des tâches qu’on identifie comme étant complexes pour des humains, seront en fait relativement simples pour les machines. Et par contre les tâches qu’on n’imagine pas complexes, comme la vision, l’interaction avec le monde, l’évitement d’obstacles, simplement attraper un objet, sont terriblement compliquées, on ne sait toujours pas le faire. »

Développer l’IA : «Ça fait peur, comme toute technologie qui peut changer la société»

« Certains ont parlé dans des termes trop excessifs des dangers possibles des systèmes d’IA jusqu’à la ‘destruction de l’humanité‘. Mais l’IA en tant qu’amplificateur de l’intelligence humaine conduira peut-être à une espèce de nouvelle renaissance, un nouveau siècle des Lumières avec une accélération du progrès scientifique, peut-être du progrès social. Ça fait peur, comme toute technologie qui risque de déstabiliser et de changer la société. »

« C’était le cas pour l’imprimerie. L’Eglise catholique disait que ça détruirait la société, mais elle s’est plutôt améliorée. Ça a engendré bien sûr l’apparition du mouvement protestant et des guerres de religion pendant un ou deux siècles en Europe, mais a également permis l’essor du siècle des Lumières, de la philosophie, le rationalisme, la science, la démocratie, la révolution américaine et la révolution française… Il n’y aurait pas eu ça sans l’imprimerie. A la même époque, au XVe siècle, l’Empire ottoman a interdit l’usage de l’imprimerie. Ils avaient trop peur d’une déstabilisation possible de la société et de la religion. La conséquence est que l’Empire ottoman a pris 250 ans de retard dans le progrès scientifique et social, ce qui a grandement contribué à son déclin. Alors qu’au Moyen Age, l’Empire ottoman a été dominant dans la science. Donc on a le risque, certainement en Europe, mais aussi dans certaines parties du monde, de faire face à un nouveau déclin si on est trop frileux sur le déploiement de l’intelligence artificielle. »

Scénarios catastrophes : « Je n’y crois pas du tout »

« L’exemple que tout le monde cite vient d’un livre de Nick Bostrom, écrit il y a quelques années qui s’appelle Superintelligence. Il décrit des scénarios catastrophe de ce qui se passerait si on faisait des machines super intelligentes. Je ne crois pas du tout à ces scénarios. Selon Nick Bostrom, à la minute ou on allume un système dont l’intelligence est surhumaine, l’humanité est foutue. C’est basé sur des hypothèses qui sont complètement fausses et ridicules. D’abord le fait que l’intelligence est toute-puissante, c’est faux. Un virus n’est pas très intelligent mais peut nous détruire. Un système développé dans le seul but est d’en combattre un autre beaucoup plus intelligent – mais généraliste –, parviendra à le détruire. Et puis, il faudrait vraiment être très stupide pour construire quelque chose qui voudrait dominer l’Homme : une machine ne peut pas être dominante par accident, si on ne lui demande pas. »

« D’autres comme Stuart Russel s’inquiètent de l’accessory goal. L’idée c’est que si on construit un robot dont le seul but est d’aller nous chercher du café et que quelqu’un s’interpose, il va tuer la personne et aller chercher du café. C’est évidemment une idée que je réfute : il suffit de lui implanter d’autres objectifs, comme ne pas trucider les humains, pour que ça n’ait pas lieu. Enfin, un problème qui inquiète, ce serait qu’un petit nombre d’entreprises contrôlent l’accès à ce genre de technologies. Et là, je suis d’accord. C’est notamment pour ça que je souhaite que le développement soit fait en open source.«

L’IA du futur : « Chacun aura une sorte de staff virtuel avec lui en permanence »

« Dans les prochaines années, on va de moins en moins utiliser les moteurs de recherche actuels. Chacun interagira avec des assistants virtuels qui répondront à n’importe quelle question, nous aideront à écrire des documents, à produire des choses. Ces assistants n’auront dans un premier temps pas l’intelligence humaine, mais peut être que d’ici une dizaine ou une quinzaine d’années, ils s’en approcheront suffisamment pour nous aider dans la vie de tous les jours. Un peu comme dans Her de Spike Jonze, l’un des rares films qui fait une peinture de l’IA plutôt réaliste. »

« Les smartphones seront aussi remplacés par des lunettes de réalité augmentée avec lesquelles on pourra interagir. Par exemple, si on raconte quelque chose de faux, les lunettes pourraient nous montrer un article de Wikipédia qui nous contredit, si quelqu’un nous parle dans une langue étrangère, elles pourraient nous afficher des sous-titres en direct. Elles pourraient aussi nous avertir d’une voiture qui vient si on traverse la rue sans regarder, nous aider à retrouver nos clefs si on les a perdues… Les possibilités sont grandes. Chacun aura, du fait des IA, une sorte d’équipe, un staff, d’assistants virtuels avec lui en permanence. »