Testez si votre ordinateur ou smartphone peut faire tourner une IA.

Le site CanIRun.ai permet, en un clic, de savoir si votre appareil est capable de faire tourner une intelligence artificielle en local. Les développeurs précisent que « lorsque vous visitez le site, nous utilisons les API de votre navigateur pour détecter votre GPU, votre CPU et votre mémoire, puis nous calculons quels modèles d’IA peuvent s’exécuter sur votre matériel et à quelle vitesse. Aucune donnée n’est envoyée à un serveur. Tout est calculé côté client ».

Un nouveau site Internet propose un outil à la fois simple et très pratique : CanIRun.ai permet, en un clic, de déterminer si votre appareil (smartphone, tablette ou PC) peut faire tourner une intelligence artificielle en local sur votre machine.

Faire fonctionner une intelligence artificielle directement sur son appareil attire de plus en plus d’utilisateurs, comme le montre OpenClaw, présenté par Clubic. Cette méthode assure une confidentialité totale des échanges et permet de travailler sans connexion Internet. Cependant, en raison de la complexité technique des modèles de langage (les fameux LLM, moteurs derrière les outils de génération de texte), il est souvent difficile de savoir si son équipement est suffisamment puissant pour gérer une telle charge de calcul.

Pour résoudre ce problème, CanIRun.ai propose une solution de diagnostic intégrée au navigateur.

### Un diagnostic matériel clair et sans jargon

Si vous êtes familier des jeux vidéo sur ordinateur, vous connaissez sûrement les plateformes qui analysent votre configuration pour indiquer si un nouveau titre fonctionnera correctement. CanIRun.ai applique ce concept à l’intelligence artificielle locale. Son but est de scanner votre matériel pour dresser une liste des modèles ouverts que vous pouvez installer sans surcharger votre ordinateur.

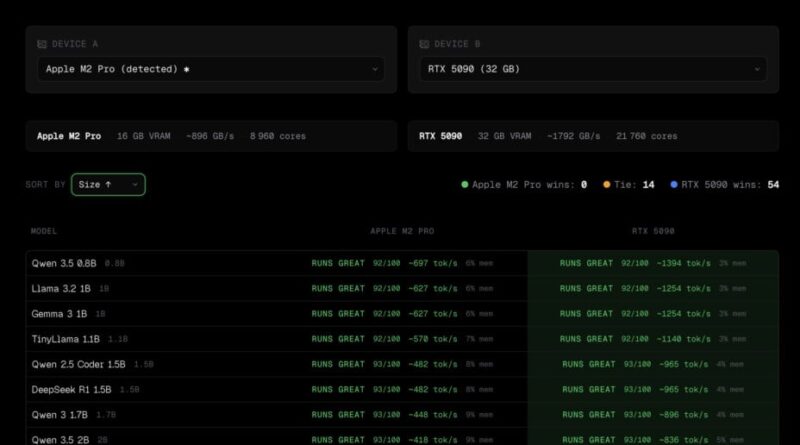

L’interface de cet outil évite le jargon technique et classe les modèles selon des critères de fluidité. Plutôt que de vous perdre dans des calculs complexes portant sur la VRAM (mémoire vidéo dédiée de votre carte graphique) ou la quantification (méthodes de compression des modèles d’IA), le site fournit un verdict simple.

Les modèles sont répartis de celui le plus adapté à celui complètement inadapté, en s’appuyant sur un large catalogue d’options open-source comme Llama, Qwen, Mistral ou Gemma.

### Les performances en pratique : l’exemple concret de Llama 3.1

Pour illustrer l’utilité de cette démarche, examinons les estimations de performances pour Llama 3.1, un modèle de langage avec 8 milliards de paramètres. L’indicateur clé fourni par l’outil est le nombre de jetons par seconde (tok/s), représentant la vitesse de génération et d’affichage des mots à l’écran.

Sur un MacBook Pro équipé d’une puce Apple M1 Pro avec 16 Go de mémoire, la vitesse estimée est de 28 jetons par seconde. Avec une puce M1 Max et 32 Go, cette cadence s’élève à 57 jetons par seconde.

| Appareil et configuration | Modèle d’IA testé | Vitesse estimée |

|————————————————|—————————————-|—————–|

| PC avec Nvidia RTX 5070 Ti | Llama 3.1 (8 milliards de paramètres) | 136 tok/s |

| Mac M1 Max (32 Go de mémoire) | Llama 3.1 (8 milliards de paramètres) | 57 tok/s |

| Mac M1 Pro (16 Go de mémoire) | Llama 3.1 (8 milliards de paramètres) | 28 tok/s |

| Mac M5 (16 Go de mémoire) | Llama 3.1 (8 milliards de paramètres) | 22 tok/s |

| iPhone 17 Pro (8 Go de mémoire) | Llama 3.2 (1 milliard de paramètres) | 31 tok/s |

Une configuration comme un MacBook Air avec une puce M5 et 16 Go affiche 22 jetons par seconde. Pour les PC fixes disposant d’une réelle puissance graphique, les résultats grimpent, avec la carte Nvidia RTX 5070 Ti atteignant 136 jetons par seconde.

L’outil évalue également les smartphones : un iPhone 17 Pro avec 8 Go de mémoire vive génère 31 jetons par seconde, mais il s’agit d’un modèle plus léger, Llama 3.2, avec 1 milliard de paramètres.

### L’avantage matériel d’Apple et la protection des données

Le fonctionnement de CanIRun.ai met en avant une caractéristique de l’architecture matérielle d’Apple. Contrairement à de nombreux PCs Windows traditionnels qui physiquement distinguent la mémoire vive et la mémoire vidéo de la carte graphique, les récents Mac utilisent une mémoire unifiée.

D’après les commentaires relayés par Numerama, les créateurs de l’outil notent que « un modèle peut utiliser jusqu’à environ 75 % de la mémoire totale », ce qui confère un avantage aux Mac dotés de mémoire vive lors du chargement de modèles d’IA exigeants.

Cependant, les Mac ne sont pas les seuls concernés ; de plus en plus de PC intègrent cette mémoire unifiée, notamment ceux équipés de puces AMD Ryzen, tels que le Framework Desktop ayant 128 Go de mémoire vive disponible directement pour le GPU.

La question de la collecte de données personnelles est évidemment cruciale lorsqu’un site analyse les composants de votre machine. Les développeurs assurent cependant une transparence totale sur la méthode utilisée. « Lorsque vous visitez le site, nous utilisons les API de votre navigateur pour détecter votre GPU, votre CPU et votre mémoire, puis nous calculons quels modèles d’IA peuvent s’exécuter sur votre matériel et à quelle vitesse. Aucune donnée n’est envoyée à un serveur. Tout est calculé côté client », expliquent-ils sur la page d’accueil de la plateforme.